Kommentare zu folgendem Beitrag: Apple: Über 90 NGOs wollen den Stopp des Apple-Kinderporno-Scanners

Das ganze neuronale Jehashe benötigt natürlich eine Rechen-Power, von ungeheurem Ausmaß, da schliesslich dabei Algorithmen immer tiefer künstlich abgeleitet werden, es werden Differenziale gebildet, die schnell das Vorstellbare der höheren Mathematik überschreiten!!

Wer so etwas schonmal ansatzweise von Hand gemacht hat, weiß wovon ich gerade spreche… ![]()

Natürlich war Äpple dabei wieder wahnsinnig schlau und dachten sich dann:

Das lassen wir besser mal von einer fertig trainierten KI / AI regeln, bevor unsere völlig überteuerten Server dabei hopps gehen!

Da man beim Thema KI selber noch nie etwas wirklich geschissen bekommen hat, wendete man sich direkt an Guuble.

Guuble, auch nicht dumm, hatten ja schliesslich noch ein ähnliches, fertiges Produkt auf Halde, was nur einmal im Real-Live eingesetzt wurde und dort kläglich versagte, auf Grund von viel mehr „FALSE“ anstatt „POSITIVES“!

Dabei war das Projektumfeld sogar dem Äppel-Projekt sehr ähnlich, nur das dort Kinder-Pornographie im Darknet vollautomatisch gesucht und gescannt werden sollte. Vor allem bei Up -und Downloads!

Die Guuble-KI ist meines Erachtens nach, danach nie wieder in der Form eingesetzt worden, müsste schon fast drei Y. her sein?! Und dieses Stück schlechtes Charma werkelt nun nach diversen Anpassungen im Äpple CP - Moloch…

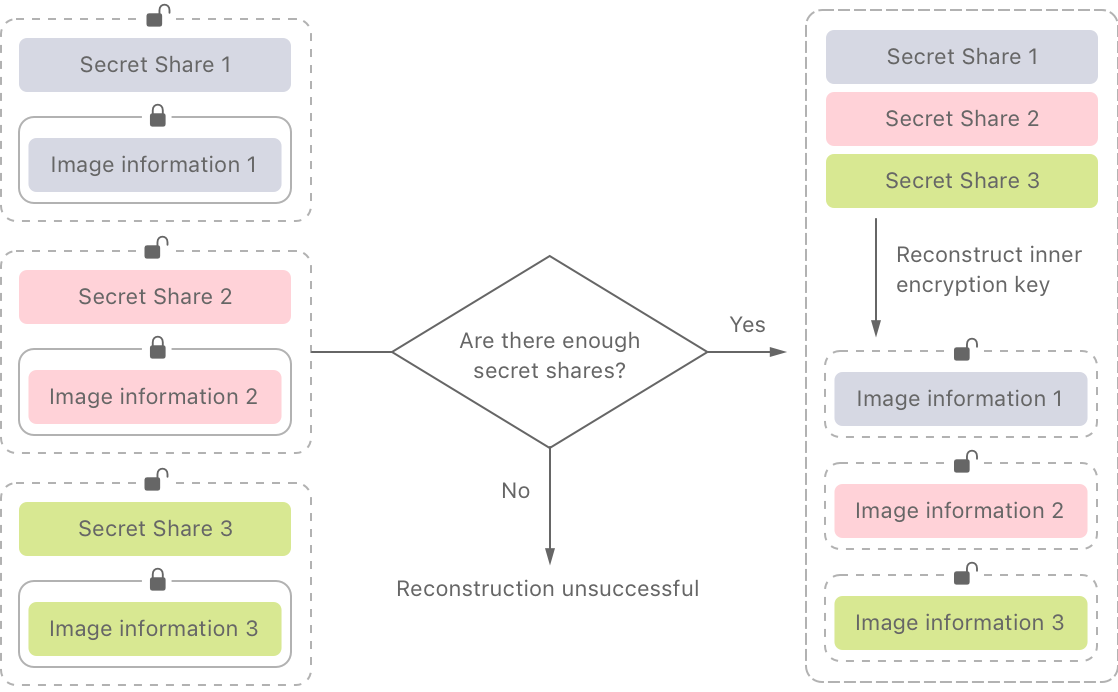

Die Grafik der EFF bringt es wieder gut auf den Punkt:

Edward Snowden hat Apples Pläne zur Einführung einer lokalen Prüfung auf Missbrauchsmaterial in iCloud-Fotos erneut scharf kritisiert: Der Hersteller schaffe damit ein Überwachungssystem, bei dem „iPhones sich selbst durchsuchen können“ und zwar nach beliebigen Inhalten, die Apple vorgibt – auf eigene oder auf fremde Anweisung. Apple schaffe damit eine neue Welt, in der iPhones gegen ihre Besitzer arbeiten.

Siehe dazu → https://edwardsnowden.substack.com/p/all-seeing-i

Apple verschiebt Scans nach Missbrauchs-Bildern um „X“ Monate!

Anfang August kündigte Apple an, Bilder auf iPhones nach verbotenen Aufnahmen scannen zu wollen. Nach viel Gegenwind folgt nun eine Reaktion.

Die Verzögerung begründet Apple damit, dass man auf das Feedback zahlreicher Experten hören wolle.

Gegenüber Bloomberg erklärte Apple aber nicht den Verzicht auf die Funktion. Vielmehr wolle man sich das Feedback zu Herzen nehmen und in den kommenden Monaten weitere Verbesserungen an dem System durchführen, damit die „wichtigen Funktionen zum Schutze der Kinder“ auch wirklich nur dafür genutzt werden könnten.

Ob man dabei mit den externen Experten zusammenarbeiten möchte oder das Tool weiterhin hinter verschlossenen Türen entwickelt, blieb offen.